Dans la formation professionnelle comme dans l’enseignement supérieur, elle est désormais omniprésente : aide à la rédaction, structuration d’analyses, génération de synthèses, préparation aux oraux…

Elle est déjà un outil de production intellectuelle utilisé par de plus en plus d’actifs.

Selon le baromètre du numérique 2026, près de 50 % d’entre eux déclarent utiliser l’IA générative, dont plus d’un tiers quotidiennement.

Et cela a des impacts sur comment elle transforme notre manière d’apprendre… et d’évaluer !

L’IA : un défi aux protocoles d’évaluation

La vitesse à laquelle l’IA et les technologies transforment les métiers explose les cadres d’évaluation traditionnels, pourtant encore largement dominés par des méthodes héritées du XIXe siècle. Dans la plupart des formations, on continue à privilégier des contrôles de connaissances standardisés (QCM, dissertations, examens théoriques), des outils conçus pour une époque où la mémorisation primait sur l’adaptabilité. À l’inverse, les mises en situation professionnelle, qui testent la capacité à agir dans un monde en mouvement, restent souvent l’exception.

A mon échelle, j’ai constaté un phénomène inquiétant : dans les livrables préparés en asynchrone par les stagiaires (dossiers, synthèses, analyses…) ou même dans la préparation d’oraux, la qualité réflexive se détériore, malgré une amélioration superficielle de la forme. En clair, les documents sont mieux structurés, mieux rédigés, mais leur profondeur d’analyse, leur originalité et leur ancrage dans une réflexion personnelle diminuent. Pire, un écart croissant apparaît entre le contenu écrit (souvent lissé, générique) et la performance à l’oral, où les lacunes conceptuelles ou méthodologiques resurgissent.

Ce constat n’est pas isolé : des enseignants universitaires et des formateurs rapportent des signaux identiques. Une enquête internationale révèle que 90 % des enseignants estiment que l’IA, utilisée sans encadrement pédagogique clair, peut affaiblir la pensée critique. La recherche académique confirme cette ambivalence : les outils génératifs améliorent la qualité formelle des productions, mais risquent de réduire l’engagement cognitif profond si l’apprenant délègue l’effort analytique à la machine.

Ce que cela révèle sur nos modèles d’évaluation

Les travaux de Guy Le Boterf ou de Philippe Perrenoud rappellent qu’une compétence ne se limite pas à produire une réponse correcte.

Elle correspond à la capacité de mobiliser des ressources de manière pertinente dans une situation donnée.

Or, dans un monde où produire un texte structuré devient simple, une question se pose :

Dans l’enseignement supérieur, certaines universités ont déjà dû adapter leurs modalités d’évaluation : davantage d’oraux, de mises en situation, de contrôles en direct.

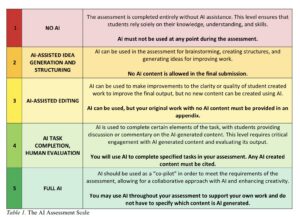

Des chercheurs ont même proposé une “AI Assessment Scale” pour définir différents niveaux d’intégration autorisée de l’IA dans les travaux évalués.

L’enjeu devient clair : mesurer l’appropriation réelle, pas seulement la production.

Un risque pédagogique : l’illusion de maîtrise

Lorsqu’un outil génère une analyse claire et structurée, le cerveau peut confondre plusieurs choses :

- Comprendre

- Valider

- Maîtriser

- Produire

Cette confusion crée une illusion de compétence.

Dans les jurys, cela devient par exemple de plus en plus visible : le document paraît solide, une présentation orale parait structurée, mais le candidat peine à expliquer certains choix ou à approfondir son raisonnement dès qu’il est challengé.

Mais à moyen terme, cela fragilise la capacité à défendre son travail, ajuster sa posture, ou décider en situation réelle.

Interdire ou encadrer ?

Interdire l’IA serait naïf.

Ne rien cadrer serait dangereux.

Plusieurs évolutions et ajustements sont possibles au niveau des certificateurs. Bien entendu, il. ne s’agit pas d’une formule magique, mais d’éléments de réflexion à intégrer selon son contexte. Il est évident que dans une filière technique on n’attendra pas nécessairement les mêmes choses que sur une formation de manager, par exemple.

Plusieurs leviers pour ne plus être passif face à l’IA :

- Diversifier les preuves de compétence (écrit + oral + mise en situation)

- Évaluer le processus de production autant que le produit final

- Former à l’usage critique de l’IA dès le démarrage des parcours

- Accompagner les jurys dans ces nouveaux repères

L’IA, comme un révélateur

L’IA agit comme un révélateur qui met en lumière une scission finalement assez ancienne dans la formation professionnelle :

👉 Valoriser la production visible

👉 Ou développer la pensée invisible

Dans un environnement où produire devient de plus en plus facile, la valeur se déplace vers :

- Le discernement

- La responsabilité

- La capacité à argumenter

- l’appropriation réelle

“Faut-il interdire l’IA ?”

Mais bien :

“Comment évaluer encore la compétence quand produire un livrable n’est plus une preuve suffisante ?”

Repenser l’évaluation à l’ère de l’IA n’est pas un sujet technologique : c’est une thématique profondément pédagogique.

Et philosophique ?